华尔街见闻

巴克莱指出,2025年AI行业有足够的算力来支持15亿到220亿个AI Agent。AI行业需从“无意义基准测试”转向实用的Agent产品部署,低推理成本是盈利关键,开源模型将降低成本。尽管算力看似充足,但高效、低成本Agent产品的专用算力仍有缺口。

继TD Cowen后,巴克莱似乎也开始唱空AI算力。

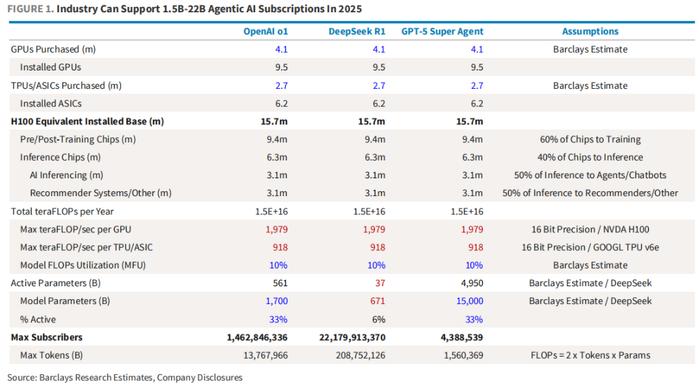

3月26日,巴克莱发布最新研究称,2025年全球AI算力可支持15-220亿个AI Agent,似乎足以满足美国和欧盟的绝大部分需求。而同日TD Cowen分析师称支撑人工智能运算的计算机集群供过于求。

巴克莱研报指出,AI行业需要从“无意义基准测试”转向真正有用的Agent产品部署。同时巴克莱分析师表示:

- AI Agent市场的增长潜力巨大: 行业算力能够支持大规模Agent部署,预示着巨大的市场机会。

- 推理成本是关键: 低推理成本对于Agent产品的盈利至关重要,这将驱动对更高效的AI模型和算力的需求。

- 开源模型的重要性: 开源模型将在降低成本方面发挥关键作用,投资者应关注相关领域的动态。

算力供需:过剩还是不足?

关于AI算力的供需平衡,巴克莱展示了几个核心发现:

- 行业推理容量基础:2025年全球约有1,570万个AI加速器(GPU/TPU/ASIC等)在线,其中40%(约630万个)将用于推理,而这些推理算力中约一半(310万个)将专门用于Agent/聊天机器人服务;

- 算力分配正在演变:企业客户已开始转向成本更低的开源模型,如Salesforce的Agentforce采用Mistral开源模型(7B-141B参数),而非最昂贵的专有前沿模型;

- 开源模型下载激增:Hugging Face数据显示DeepSeek、Llama和Mistral等开源模型的下载量正在迅速增长,这一趋势将随着从聊天机器人向Agent的转变而加速。

算力供应虽然表面上充足,但面临结构性挑战。巴克莱明确表示:

如果Agent产品真正起飞并对消费者和企业用户非常有用,我们可能需要

1)更便宜、更小但性能同样高的基础模型(DeepSeek风格);

2)更多推理芯片安装;以及

3)可能需要将已安装的训练GPU重新用于推理。

这表明,虽然目前总体算力看似充足,但针对高效、低成本Agent产品的专用算力仍有较大缺口。巴克莱指出这意味着,在AI Agent赛道上,具有高效推理成本结构和专注开发小型高效模型的公司可能拥有更大竞争优势,而仅依赖大模型而不考虑单位经济学的公司可能面临更大挑战。

推理成本:AI Agent的经济学挑战

巴克莱指出AI Agent的推理成本正成为行业发展的核心考量因素:

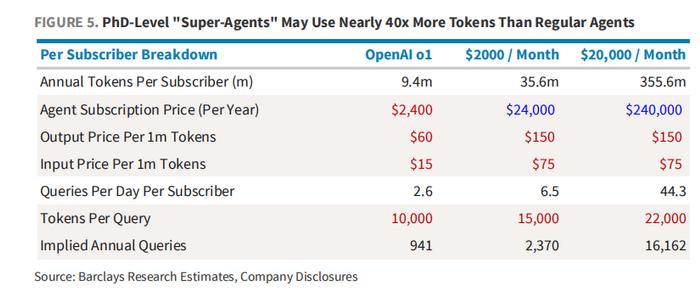

- AI Agent生成的Token数量巨大:相比传统聊天机器人,Agent产品每次查询生成约10,000个Token,是聊天机器人(约400个)的25倍,这极大增加了推理成本;

- 不同模型的经济效益差异巨大:以年度订阅成本计算,基于OpenAI o1模型的Agent产品成本高达2,400/年,而基于DeepSeekR1模型仅需88/年,后者提供了15倍于前者的用户容量;

- 超级Agent需求正在兴起:OpenAI计划推出的"超级Agent"产品,这类高端产品将消耗更多Token,每月高达3,560万个,每日查询次数可达44次,远超普通Agent的2.6次。

从单位经济学角度看,以Token计价的模式将决定不同模型的市场竞争力。正如巴克莱研究指出:

这证明了低推理成本的重要性。由于其自主性质,Agent AI产品的Token消耗趋势远高于聊天机器人。

市场有风险,投资需谨慎。本文不构成个人投资建议,也未考虑到个别用户特殊的投资目标、财务状况或需要。用户应考虑本文中的任何意见、观点或结论是否符合其特定状况。据此投资,责任自负。