前不久,网上流传着一段煞有其事的聊天记录。

传播者声称,“广州地铁三号线,有位美女没穿衣服”。还配上了一张大尺度的照片。

照片一经发出,立即在网上病毒式传播,短短一天时间就冲上热搜,引来大批不怀好意的评论。

爆料者还言之凿凿,这是有金主给美女下了任务,所以才会有这样一场“表演”。

如此解释,一件桃色新闻的前后逻辑好像都说得通了。

但实际上,这是一场彻头彻尾的谣言。

那张所谓的香艳照片,是造谣者使用AI一键脱衣合成的假照。

原图是一张非常正常的照片,当事女孩是一名博主。

8个月前,她在小红书上发了一张通勤生活照,衣着合理,没有一丝不恰当之处。

没想到过了这么久,竟遭遇这样一场无妄之灾。

可即使报了警维权,女孩的名誉也遭到诋毁,身心留下巨大创伤。

这位博主并非唯一一位AI技术受害者。

一周前,一位网红特效师在网上晒出脸上的伤痕,说自己遭到迪丽热巴粉丝的殴打。

他原本想给自己讨点公道,不料事情缘由讲清楚后,反被网友泼了一盆冷水。

原来,这位网红利用所学的AI技术,把电视剧中男演员的脸替换成了自己,跟迪丽热巴演起了吻戏。

这并非第一回,他还多次把自己P进其它电视剧里,和多位女星左拥右抱。

画面非常龌龊、猥琐,让人看了生理不适。

网友们抨击他行为恶臭,好好的AI特效,却用来满足自己的意淫,还发出来博取眼球。

而且从法律层面讲,他的行为已经严重侵犯了剧中明星的肖像权、名誉权。

无独有偶,在苏州大学和南华大学,也先后出现学生利用AI技术,对女生进行P图造黄谣的事件,多位女生遭到污名化,心理上留下巨大阴影。

其实,这些都只是冰山一角。

在一些非法网站上,利用AI技术制作不雅视频,已经成了一条灰色产业链。

2019年,一款名为DeepNude的脱衣APP,和一款名为ZAO的换脸APP,一经发布迅速爆火,但由于舆论争议过大,开发公司没几天就将应用下架。

但是,潘多拉魔盒已经打开,类似APP潮水般涌入市场,甚至公然在应用商店上架。

国内外众多知名女星,如杨幂、热巴、关晓彤等,日本的石原里美、桥本环奈,韩国的IU,美国的斯嘉丽·约翰逊、盖尔·加朵等人,均出现在小电影里被迫“下海”。

本应造福社会的AI科技,却被一些人品卑劣的人用来牟取非法利益,给他人带来巨大的伤害。

也许有人认为,我只是个长相平平的男生,没啥好怕的。

但要知道,换脸仅仅是AI最浅显的运用,AI科技的发展,早已达到普通人无法想象的地步。

很多企业、组织都在运用AI,提升商业运行效率,以获取更大的利润。

然而,由于目前的法律和制度没有明确AI的使用边界,科技滥用的行为比比皆是。

现代社会AI已经无处不在,无孔不入,它正以润物细无声的方式,深刻影响着我们的生活。

你认为,这个世界上谁最了解你?

是父母、爱人、朋友,还是你自己?这些都不一定。

现在,有一个明确的答案,那就是AI。

我们或许都有过这样的经历:

和同事聊起午餐要吃什么,然后等你打开外卖APP时,首页上给你推荐的就是刚才讨论过的美食。

放假前和朋友、闺蜜讨论,假期要去哪个地方玩,APP上给你推荐的,就全是当地的酒店、景点、门票。

换季时想要买一双鞋、一件外套,你甚至不曾跟别人说过这件事,打开淘宝时,都会收获满屏的目标商品推荐。

这种诡异场景,就是AI为我们推送的定制化服务。

AI很懂你,比家人、朋友更知道你需要什么。

它之所以能做到这些,是以获取隐私为前提,对我们进行精准化营销。

简而言之,AI一直在窥探用户的隐私,而且随着科技的进步,这种窥伺会更加隐蔽且准确。

有人会说,无所谓啊,AI懂我们,岂不是可以更加便利地服务我们的生活?

但是,所有的馈赠都在暗中标好了价码。

谁能确定AI背后的操控者,不会利用大数据对我们进行收割。

实际上,这种收割已经有了苗头。

订一个酒店,同样的房间,两个手机呈现出的价格可能相差不少。

买同样一件商品,不同手机搜出来的价格,也会有一些区别。

打网约车,同一个APP,同样的地点,两个手机搜出来价格也不尽相同。

这也是AI为我们推送的个性化服务,它会根据每个人近期的消费水准,提供价格不一的商品或服务。

用一个词来形容,就是大数据杀熟,你用一个APP越多,消费水平越高,它收取你的费用就越多。

提起AI对人的操控,大多数人感受可能不是太深,但外卖骑手就有深刻的体会。

在外卖系统里,骑手必须在规定时间内完成送餐,而送餐时间的标准是由算法来决定的。

最近几年,这个标准正在算法的优化下,变得越来越短。

那么算法是如何计算时间的呢?

它给骑手规划出了“最优路线”,这个路线能上天桥、越围墙,甚至逆行。真实的路况、天气等因素却没有充分考虑进去,这样算出来的送达时间,当然是最短的。

为了在规定时间内完成送餐,骑手们只能在路上狂飙,有时为了多赚几块钱,他们就会在路上横冲直撞。

算法确实帮助骑手选出了“最便捷”的道路,代价却是牺牲了骑手的安全。

当然,绝大多数人不是骑手,没有遭受AI的直接控制,但这并不意味着AI对我们的影响就更低。

在我们看不见的地方,AI正在以潜移默化的方式,对用户的个人认知施加影响,这种影响不知不觉、悄无声息,却触及根本。

这种个人认知层面的影响,来源于当下AI科技控制下的内容信息平台。

现有的内容分发平台,都在以算法推荐为基础,不断采集用户兴趣偏好,有针对性地推送信息。

无论是刷短视频、看文本内容、听音乐,我们接触到的,基本都是感兴趣的、赞同的、喜欢的内容。

这的确帮助用户节省了大量精力,甚至越看越有愉悦感。

然而,AI算法的过度迎合,让用户只能接收到同一性的观点、内容,接触不到不同的信息观念。久而久之,便将我们置于一个无法脱困的“信息茧房”之中,最终便会认知固化、思维僵化。

有一个典型的例子,西方国家很多人在媒体的虚假宣传下,至今仍认为中国还是上世纪五六十年代的样子,这种观念在他们脑子里已经根深蒂固。

试想一下,如果有一个巨头企业,利用AI科技掌握了我们所有的喜好、理念、性格,那他就可以控制我们所能看到的、听到的一切内容,进而控制我们的思想。

这并非危言耸听,科幻电影中对这种现象早有描述,它叫做:赛博朋克。

在赛博朋克的世界里,人类的身体可以被机器任意替换,人性之间万分冷漠,贫富差距极度鲜明……人类生活的每一个细节,都被AI机器人精准控制着。

换句话说,机器变成了人,而人被驯化成了机器,科技成了剥削人类的手段。

既然AI作恶现象已经到了泛滥的地步,那直接将它封禁可以吗?

这既不可能,也没必要。人类社会发展至今,不管科技处于什么水平,都存在矛盾、冲突甚至战争。

科技运用产生的所有问题,本质上都是人类社会的问题。

有人用AI来作恶、害人、操控人,也有人用它来扬善、救人、造福世界。

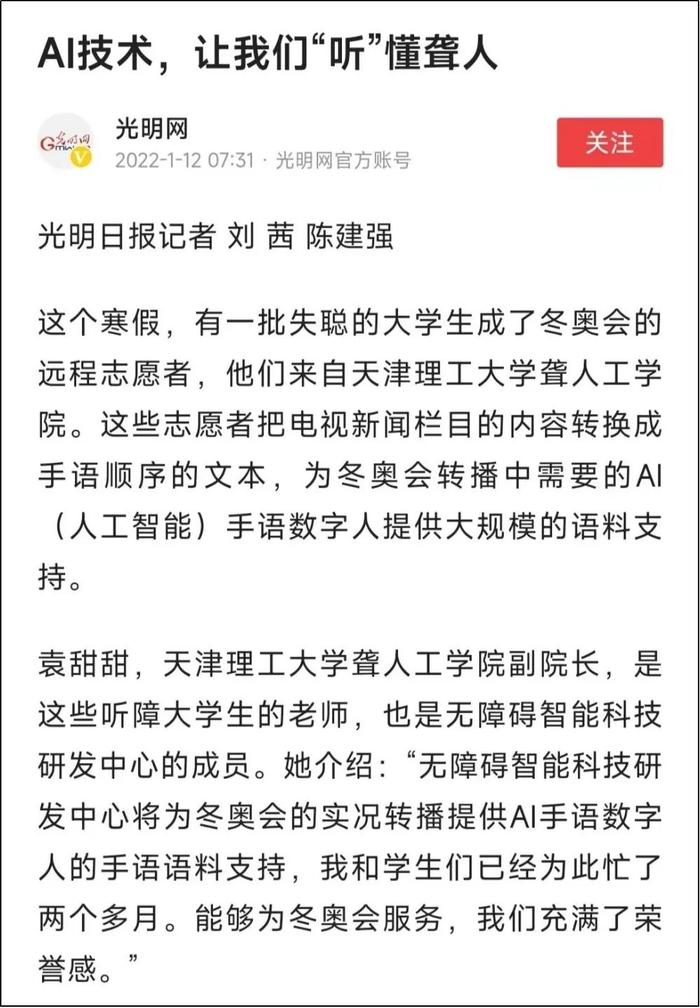

比如2022年冬奥会时,天津理工大学的一批学生,就曾为AI手语数字人提供大规模的语料支持,让听障人士也能“听见冬奥”,感动了大批听障观众。

在防诈骗领域,AI也帮助过人们拦截、挽回了大量损失。

去年7月的世界人工智能大会现场,蚂蚁集团公布了一组数据:他们的AI机器人可以在0.1秒内发出警报提醒,及时拦截用户被骗转账。半年内,这个反诈AI平均每天发出预警50万次,保护了27亿潜在资金损失。

这些,都是AI扬善的具体案例。在我们的社会生产中,AI科技也逐渐扮演着重要角色。

去年12月,深圳大学16名人工智能特色班的学生,运用AI技术,耗时100天,帮助养殖户改造了一个智能化的鹅场。

他们先是给500平米的鹅场装上全景无死角摄像头,随后创建了一个智能养鹅的AI算法。

从此之后,农户不再需要24小时守在鹅舍,就可以远程监控鹅场内的温度、湿度、PM2.5指数变化,还可以实时监测到鹅的状态,及时发现哪只鹅发烧、生病,这让整个鹅场的存活率提高了30%。

类似的AI科技,在我国的养猪业、采矿、冶金、智能制造等领域都已经纷纷开始运用。

这才是科技发展的真正意义。

任何事物都有两面性,关键在于如何趋利避害。

即使是AI技术发展的集大成者,现在爆火的ChatGPT,也呈现截然相反的两面。

有人用它辅助写作,帮助自己快速成文;有人用它绘制图片,大幅提高制作效率;有人用它分析数据,精准找出数据背后藏着的奥秘;有人用它帮助制定公司战略,节省一大笔资金成本。

但在一些心术不正的人手里,ChatGPT却是一个帮凶。

有人用它钓鱼诈骗,企图不劳而获;有人用它绘制不雅图片,满足龌龊心理;有人用它制造虚假信息,煽动人群对立。

所以,在未来世界的大门已经打开的情况下,AI是行善还是作恶,归根结底都取决于人。

在好人手中,AI将绽放耀眼的光辉;在坏人手中,AI将放大人性的黑暗。

人类社会的一个个案例早已表明,如果科技作恶,错的不会是AI,而是AI背后的人性。

马斯克曾说,AI可能是人类最大的威胁,研究AI如同在召唤魔鬼。

其实,真正让人恐惧的不是AI,而是AI沾染上人性中的恶,那才是真正的恶魔。

科技进步的速度不会放缓,但我们需要给科技的运用划下一道边界,保证科技向前的同时,也要向善。

资料来源:

光明网:《女子照片被AI“一键脱衣”,网友怒了》

澎湃新闻:《特效师用AI换脸和迪丽热巴“亲吻”,律师:涉嫌侵权》

北京日报:《有图有真相?AI换脸,杨幂中招,制作方回应了》

环球时报:《2亿人被困在系统里?国家出手了》

光明网:《AI技术,让我们听懂聋人》

信息时报:《用AI帮助养鹅!这群00后大学生值得一个热搜》

作者:钟有鱼,首发:家庭杂志(ID:jiatingzazhi)